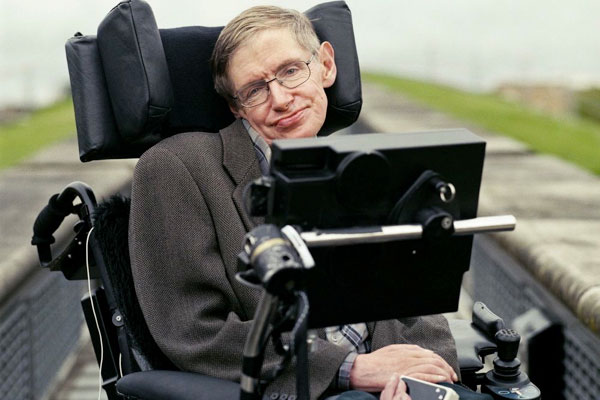

Ünlü teorik fizikçi ve kozmolog Stephen Hawking, yapay zeka hakkındaki uyarılarını sert açıklamalarla tekrarladı. Hawking, yapay zeka ve robotik alanında çalışmalar yapılacak Leverhulme Zekanın Geleceği Merkezi açılışında, ‘insanlığın en büyük hata veya en doğru hamle arasında olduğunu’ söyledi. Hawking, ‘yapay zeka hakkında halen çok fazla çalışması yapılması gerektiğini’ ifade etti.

Hawking, geçmişte yapay zeka hakkında birçok uyarıda bulunmuş, hatta Elon Musk gibi teknoloji milyarderleri ve akademik isimlerle yapay zekaya karşı B Planı hazırlanması için açık mektup sunmuştu. Hawking, insanlığın kendi hataları nedeniyle Dünya’da kendi sonunu getireceğini ve mutlaka yeni gezegenlere koloni kurması gerektiğini de söylemişti.

Hawking, merkezin açılışında yaptığı konuşmada şu ifadeleri kullandı: ‘Tarih üzerinde çalışarak çok büyük bir zaman harcadık. Haydi bununla yüzleşelim, tarihin çoğu, aptallığın tarihidir… Fakat geçmişteki hatalara bakarak harcadığımız tüm zamana rağmen, aynı hataları tekrar tekrar yapıyor gibiyiz… Bu yüzden, insanların zekanın geleceği üzerinde çalışması güzel bir değişim.”

‘Zararın bir kısmını ortadan kaldırabiliriz’

Hawking, 19 Ekim’de yaptığı konuşmada ‘güçlü otonom silahlar’ ve ‘kitlelere baskı yapmaya izin verecek teknolojiler’ hakkında halen endişeli olduğunu söyledi. Hawking, yine de bu konulara şimdi odaklanırsak, teknolojinin fayda sunma potansiyelini ortaya çıkarabileceğimizi belirtti.

Hawking, “Zihinlerimiz yapay zeka tarafından güçlendirildiğinde ne gibi başarılar elde edeceğimizi tahmin edemeyiz” ifadesiyle kontrolsüz zekanın tehlikelerine dikkat çekti.

Sanayi devriminin doğa üzerinde oluşturduğu tahribatı yeni teknolojik devrimin araçlarıyla giderebiliriz.

Hawking, “Yeni teknoloji devriminin araçlarıyla belki de bir önceki aracın (sanayi devrimi) doğada neden olduğu tahribatı giderme şansımız olabilir. Ve nihayetinde hastalık ve yoksulluğu ortadan kaldırmaya yöneleceğiz” dedi.

12 milyon dolar destekle kurulan Leverhulma Zekanın Geleceği Merkezi, tüm riskleri dikkatli bir şekilde inceleyerek yapay zekanın sunabileceği tehditleri analiz edecek. Hawking, merkezde görevli profesörler arasında yer alıyor.

Geleceğin tehditleri şimdiden analiz ediliyor

Leverhulme Zekanın Geleceği Merkezi, Cambridge Üniversitesi’nin Varoluşla İlgili Riskler Merkezi’nde ilham almış bir oluşum. Merkezde, ‘Terminatör Araştırmaları’ gibi insanlığı bekleyen muhtemel tehlikeler ele alınıyor.

Leverhulme ise iklim değişikliği ve savaşların haricinde, sadece makinelerin insanlar için oluşturabileceği tehlikeleri analiz edecek.

Leverhulme Merkezi direktörü Huw Price, “Makine zekası yüzyılımızın belirleyici temalarından biri olacak ve bizler hep beraber karşımıza çıkacak fırsatlardan fayda sağlamayı hedeflemeliyiz” dedi.

Price, bulunduğumuz noktada makinelerin sunacağı imkanları henüz yeni yeni anlamaya başladığımızı söyledi.

Bu makalede Bilim Türkiye sayfasından yararlanılmıştır.